26 févr. 2026

Le guide ultime de la conformité IA et RGPD en 2026

Découvrez comment aligner IA et RGPD. Ce guide complet vous explique les risques, vos obligations et les stratégies pour transformer la conformité en avantage.

L'intelligence artificielle et le RGPD, c'est un peu le mariage de la carpe et du lapin ? Pas du tout ! Il faut plutôt les voir comme les deux faces d’une même pièce : celle de l’innovation responsable. Imaginez l'IA comme un moteur de Formule 1 surpuissant, capable de performances hallucinantes. Le RGPD, lui, c'est le châssis et les règles du circuit : il assure que toute cette puissance reste sous contrôle, pour la sécurité de tous. Bien les faire cohabiter n'est plus une option, c'est une nécessité stratégique pour toute entreprise qui veut innover sans finir dans le décor.

IA et RGPD : un choc des titans ou une danse bien orchestrée ?

L'idée que le RGPD serait le grand méchant loup qui vient dévorer l'innovation en IA a la vie dure. C'est un mythe qui provient souvent d'un malentendu. D'un côté, on a une révolution technologique qui se nourrit de données comme un ogre. De l'autre, un cadre juridique conçu pour protéger nos droits les plus fondamentaux. Leur rencontre était inévitable, mais elle n'est pas forcément explosive.

Le vrai défi, ce n'est pas de choisir son camp. C'est de trouver la bonne chorégraphie. L'IA a un appétit féroce pour les données, c'est son carburant pour apprendre et s'améliorer. Le RGPD, lui, ne dit pas "stop, on ne touche plus à rien". Il dit simplement : "servez-vous, mais faites-le de manière juste, transparente et sécurisée".

Quand la contrainte devient un super-pouvoir

Pour un dirigeant ou un consultant, voir le RGPD comme une simple liste de corvées à cocher est une grave erreur de jugement. En réalité, c'est une occasion en or de se démarquer. Une entreprise qui maîtrise l'articulation IA et RGPD envoie un signal extrêmement fort à son écosystème.

Elle dit à ses clients, partenaires et investisseurs : "vous pouvez nous faire confiance". Elle prouve qu'elle n'innove pas à l'aveugle, mais qu'elle pilote sa stratégie avec une vision claire de ses responsabilités.

Le RGPD n'est pas le frein de l'IA, c'est sa ceinture de sécurité. Il nous force à passer de la question "Est-ce qu'on peut le faire techniquement ?" à "Est-ce qu'on devrait le faire éthiquement ?". C'est ce simple changement de perspective qui construit les innovations qui durent.

Maîtriser ce duo improbable, c'est s'offrir de sacrés avantages :

Gagner la confiance des clients, qui sont de plus en plus méfiants sur l'usage de leurs données. C'est le nouveau nerf de la guerre.

Sécuriser ses investissements en IA en évitant de miser des millions sur des projets qui se révéleront illégaux.

Éviter les amendes salées, qui peuvent grimper jusqu'à 4 % du chiffre d'affaires mondial. De quoi faire réfléchir.

Soigner son image de marque en se positionnant comme un leader de l'innovation qui a le sens des responsabilités.

Une compétence indispensable pour 2026 et après

Ne nous voilons pas la face : l'ère du "Far West" de l'IA est terminée. Les autorités de contrôle, comme la CNIL en France, affûtent leurs outils et intensifient leurs contrôles. L'expérimentation sans garde-fous n'est plus une option. La question n'est plus de savoir si vos projets IA seront inspectés, mais quand.

Ce guide est votre copilote. Nous allons décortiquer le jargon juridique, cartographier les pièges spécifiques à l'IA et vous donner une feuille de route claire pour faire de la conformité un accélérateur de croissance. L'objectif est simple : vous donner les clés pour appuyer sur le champignon de l'IA, mais en toute sécurité.

Décrypter les principes du RGPD pour vos projets IA

Lancer un projet IA sans traduire le RGPD en langage clair, c'est un peu comme monter un meuble suédois en lisant la notice en mandarin. C'est possible, mais le résultat risque d'être bancal et, soyons honnêtes, dangereux. Alors, mettons de côté le jargon juridique un instant. Concentrons-nous sur les questions que vous devez vraiment vous poser sur le terrain.

Le but du jeu est simple : transformer chaque grand principe du RGPD en un réflexe opérationnel. Au lieu de réciter l'article 5 par cœur, demandez-vous plutôt : "Concrètement, avons-nous une raison valable et légale d'utiliser ces données pour notre algorithme ?" C’est ce passage de la théorie à la pratique qui fait toute la différence entre une conformité de façade et une véritable gouvernance IA et RGPD.

Licéité, loyauté et transparence

Ces trois-là, c'est le socle, la fondation de toute collecte de données. Pour un projet IA, ça veut dire une chose : jouer cartes sur table avec les personnes dont vous utilisez les informations.

La question clé est donc la suivante : sur quelle base légale notre IA a-t-elle le droit de s'entraîner ? Le consentement est souvent la voie la plus sûre, mais attention, il doit être explicite, libre et éclairé. Un vague "J'accepte les conditions" perdu au fin fond d'une page ne passera jamais.

Voyez votre IA comme un chef cuisinier. Le principe de transparence l'oblige à afficher clairement la liste de tous ses ingrédients (les données) et à expliquer sa recette de manière simple. Le client doit savoir ce qu'il va manger avant même de commander.

Par exemple, un site e-commerce qui utilise une IA pour recommander des produits doit expliquer noir sur blanc que l'historique d'achat et de navigation sert à personnaliser l'expérience. L'utilisateur doit comprendre le "pourquoi du comment" et pouvoir dire non.

Limitation des finalités et minimisation des données

C'est ici que l'appétit féroce de l'IA pour les données se heurte frontalement au RGPD. La tentation est immense de gaver votre modèle avec un maximum de données, en pensant "plus il en a, plus il sera malin". C'est un piège classique.

Le RGPD vous impose deux garde-fous essentiels :

Limitation des finalités : Vous ne pouvez utiliser les données que pour l'objectif précis annoncé au départ. Point. Si vous avez collecté des infos pour la facturation, interdiction de les réutiliser en douce pour entraîner un algorithme de prédiction comportementale.

Minimisation des données : Avez-vous vraiment besoin de connaître la date de naissance d'un client pour lui recommander un pull ? Le principe est de ne collecter que ce qui est strictement nécessaire à votre objectif.

Cette double contrainte force à une discipline qui, au final, est très saine. Elle vous pousse à mieux définir votre projet IA et à vous concentrer sur la qualité des données plutôt que sur leur quantité brute. Et devinez quoi ? Ça améliore souvent la performance réelle du modèle.

Exactitude, conservation et sécurité

Une fois les données collectées, le travail ne fait que commencer. Votre système d'IA doit être capable de gérer tout le cycle de vie de la donnée, de sa naissance à sa suppression.

Pensez à votre IA comme à un jardinier méticuleux. Il doit s'assurer que ses plantes (les données) sont saines (exactitude), arracher les mauvaises herbes (les données erronées) et ne pas laisser ses cultures envahir tout le terrain indéfiniment (limitation de la conservation). Bien sûr, il doit aussi installer une clôture solide pour protéger son potager (sécurité). Pour une vision concrète de ces principes en action, jeter un œil à la politique de confidentialité de Goglow est un excellent exercice pour comprendre comment ces règles sont appliquées.

Très concrètement, si un client met à jour son adresse, votre modèle doit en tenir compte. Si un utilisateur demande à supprimer son compte, toutes les données qui lui sont liées doivent disparaître de vos bases d'entraînement. C'est un défi technique majeur qui doit être pensé dès la conception du projet, pas après.

Identifier les nouveaux angles morts de l'IA

Les dangers de l'intelligence artificielle ne se résument plus à la simple peur d'une fuite de données. C'est une vision dépassée. Aujourd'hui, on entre dans une ère de menaces bien plus subtiles, plus complexes, où les algorithmes eux-mêmes deviennent des vecteurs de problèmes. Imaginer la sécurité de l'IA uniquement en termes de "protection des bases de données", c'est un peu comme installer une porte blindée tout en laissant les fenêtres grandes ouvertes.

Il est grand temps de dessiner la carte de ces nouveaux angles morts, ces zones de vulnérabilité qui naissent au cœur même du fonctionnement des modèles d'IA. Comprendre ces risques est la toute première étape, celle sans laquelle il est impossible de construire une stratégie IA et RGPD qui tienne la route et qui protège vraiment votre entreprise.

Le fléau silencieux du biais algorithmique

Imaginez un instant. Vous déployez une IA de recrutement pour analyser des milliers de CV et dénicher la perle rare. Sur le papier, le gain de temps et d'efficacité est énorme. Mais que se passe-t-il si votre modèle a été entraîné avec les données de recrutement des dix dernières années, des données qui, peut-être, reflétaient des préjugés inconscients bien ancrés ?

L'IA, en élève appliqué, va non seulement apprendre ces biais, mais les amplifier. Elle pourrait se mettre à écarter systématiquement les candidatures de femmes pour des postes techniques, ou celles de personnes venant de certains quartiers. Non par malveillance, mais simplement parce qu'elle a détecté un "pattern" dans les données qui l'ont nourrie. Votre super outil de productivité se transforme alors en une redoutable machine à discriminer, vous exposant à des conséquences juridiques et réputationnelles dévastatrices.

Un algorithme n'est jamais neutre. Il est le miroir numérique des données qui l'ont nourri et, par extension, des préjugés de la société qui les a produites. Le plus grand risque est de croire qu'une machine est intrinsèquement plus objective qu'un humain.

Ce risque de discrimination est une cible directe du RGPD, qui martèle l'importance d'un traitement loyal et non discriminatoire des données. L'utilisation, même involontaire, d'une IA biaisée peut donc constituer une violation frontale de ce principe fondamental.

Le profilage à grande échelle et le casse-tête de la ré-identification

La magie de l'IA, c'est sa capacité à voir des corrélations invisibles pour nous, pauvres humains. C'est ce qui lui permet, par exemple, de déduire des informations très intimes (opinions politiques, état de santé, orientation sexuelle) à partir de données qui semblent totalement anodines, comme de simples "likes" sur les réseaux sociaux.

Ce profilage à grande échelle est l'un des angles morts les plus inquiétants. Il peut mener à des décisions automatisées qui bouleversent la vie des gens : un refus de prêt, une augmentation de prime d'assurance... le tout, sans qu'ils ne comprennent vraiment pourquoi.

En parallèle, un autre fantôme plane sur vos efforts d'anonymisation : la ré-identification. Vous pensez être en sécurité en retirant les noms de vos jeux de données avant de les utiliser ? Détrompez-vous. Une IA suffisamment maligne peut croiser ces informations avec d'autres sources de données publiques pour "ré-identifier" une personne et lui réattribuer ses données personnelles.

Ces pratiques posent des défis considérables. L'exploration des défis de l'IA révèle comment des technologies comme l'IA de reconnaissance faciale soulèvent de nouvelles questions éthiques et légales complexes. La frontière entre données anonymes et données personnelles devient de plus en plus floue. Pour une vue d'ensemble sur la gestion de ces dangers, notre guide sur le risque de l'intelligence artificielle est un excellent point de départ.

Le défi de la boîte noire algorithmique

Voilà l'un des plus grands paradoxes de l'IA moderne, surtout avec les modèles complexes comme les réseaux de neurones profonds : leur opacité. On parle souvent de "boîte noire" (black box), car même leurs créateurs sont parfois incapables d'expliquer précisément comment l'algorithme est parvenu à une conclusion.

Ce brouillard est un problème majeur face au RGPD, qui accorde des droits très clairs aux citoyens :

Le droit à l'information : Les gens doivent être informés de la logique derrière un traitement automatisé.

Le droit d'accès : Ils peuvent demander à savoir quelles données sont utilisées et comment.

Le droit d'opposition à une décision 100% automatisée : Pour les décisions qui ont un impact juridique ou significatif, une intervention humaine doit rester possible.

Comment diable garantir ces droits si personne n'est capable d'expliquer la décision de l'IA ? L'incapacité à "ouvrir le capot" de l'algorithme vous met directement en porte-à-faux avec la loi. La traçabilité et l'explicabilité ne sont plus de simples options techniques, ce sont devenues des obligations légales.

Cartographie des risques IA et leurs conséquences RGPD

Pour y voir plus clair, il est utile de mettre en correspondance directe les risques techniques de l'IA avec les principes du RGPD qu'ils peuvent violer. Ce tableau sert de "traducteur" entre le monde de la data science et celui du droit.

Risque spécifique à l'IA | Principe RGPD impacté | Exemple concret | Conséquence pour l'entreprise |

|---|---|---|---|

Biais algorithmique | Loyauté, équité et non-discrimination (Art. 5) | Un algorithme de scoring de crédit pénalise systématiquement les candidats habitant dans certains codes postaux. | Décisions discriminatoires, plaintes, sanctions financières, atteinte à la réputation. |

Profilage non consenti | Finalité et consentement (Art. 5 & 6) | Une IA analyse les posts sur les réseaux sociaux pour déduire l'orientation politique des utilisateurs et leur envoyer de la publicité ciblée. | Traitement illicite de données sensibles, amendes très lourdes, perte de confiance des utilisateurs. |

Ré-identification | Anonymisation et sécurité (Art. 25 & 32) | Un jeu de données médicales "anonymisé" est croisé avec une base de données publique, permettant de retrouver l'identité des patients. | Violation de la sécurité des données, risque de chantage ou de discrimination, sanctions de la CNIL. |

Opacité ("boîte noire") | Transparence et droits des personnes (Art. 13-15, 22) | Une personne se voit refuser une assurance-vie par une IA sans qu'on puisse lui expliquer les critères exacts de cette décision. | Incapacité à répondre aux demandes d'accès et d'explication, violation des droits fondamentaux, invalidation du traitement. |

Ce tableau n'est pas exhaustif, mais il illustre bien le lien de cause à effet : un problème technique dans votre IA se transforme quasi-automatiquement en un problème juridique pour votre entreprise. Anticiper ces risques n'est donc pas une option, c'est une nécessité.

Bâtir votre feuille de route pour une IA conforme

Ok, maintenant qu'on a bien éclairci les zones d'ombre, il est temps de retrousser ses manches et de passer à l'action. Mettre ses projets IA en règle avec le RGPD peut faire peur, un peu comme une montagne à gravir. Mais avec la bonne carte, l'ascension devient tout de suite plus gérable. Voyez ça, non pas comme une corvée, mais comme la construction des fondations en béton armé de votre future innovation.

Le coup d'envoi de ce chantier ? C'est l'AIPD (Analyse d'Impact sur la Protection des Données). Oubliez tout de suite l'image du vieux formulaire administratif qui prend la poussière. Considérez plutôt l'AIPD comme le "business plan" de votre conformité. C'est un exercice hyper stratégique qui vous oblige à cartographier les risques, à peser leur probabilité et à prévoir des parades pour les contrer, avant même d'avoir tapé la moindre ligne de code.

L'AIPD est à la conformité IA et RGPD ce que le plan de vol est à un pilote d'avion. Personne n'imagine décoller sans savoir où il va, quelles turbulences l'attendent et comment y faire face. C'est exactement la même logique pour un projet IA.

Se lancer dans une AIPD sérieuse, c'est choisir d'anticiper les problèmes plutôt que de les subir en pleine face. C'est l'outil magique qui transforme une approche réactive (et souvent très chère) en une démarche proactive et parfaitement maîtrisée.

Intégrer la protection des données dès la première esquisse

Le Privacy by Design, ou la protection de la vie privée dès la conception, est le véritable cœur du réacteur de cette feuille de route. L'idée est d'une simplicité désarmante mais incroyablement puissante : la protection des données n'est pas un sparadrap qu'on vient coller à la fin du projet. C'est un ingrédient clé de la recette, dès le début. C'est une fonctionnalité à part entière, pas un bricolage de dernière minute.

Concrètement, ça se traduit par des actions très précises à chaque étape de votre projet IA :

Pendant la conception : Quels sont les risques ? Comment peut-on ne collecter que le strict minimum de données ? Comment s'assurer que le modèle ne soit pas une boîte noire impénétrable ?

Pendant le développement : Quelles protections de sécurité (chiffrement, pseudonymisation) faut-il intégrer directement dans le code ? Comment garder une trace des décisions de l'algorithme ?

Pendant le déploiement : Comment informer les utilisateurs de façon limpide ? Comment leur permettre d'exercer leurs droits (accès, suppression) sans avoir à chercher pendant des heures ?

En adoptant ces réflexes dès le départ, vous vous épargnez des refontes techniques aussi complexes que coûteuses par la suite. C'est un petit investissement au début qui rapporte gros, très gros, sur le long terme.

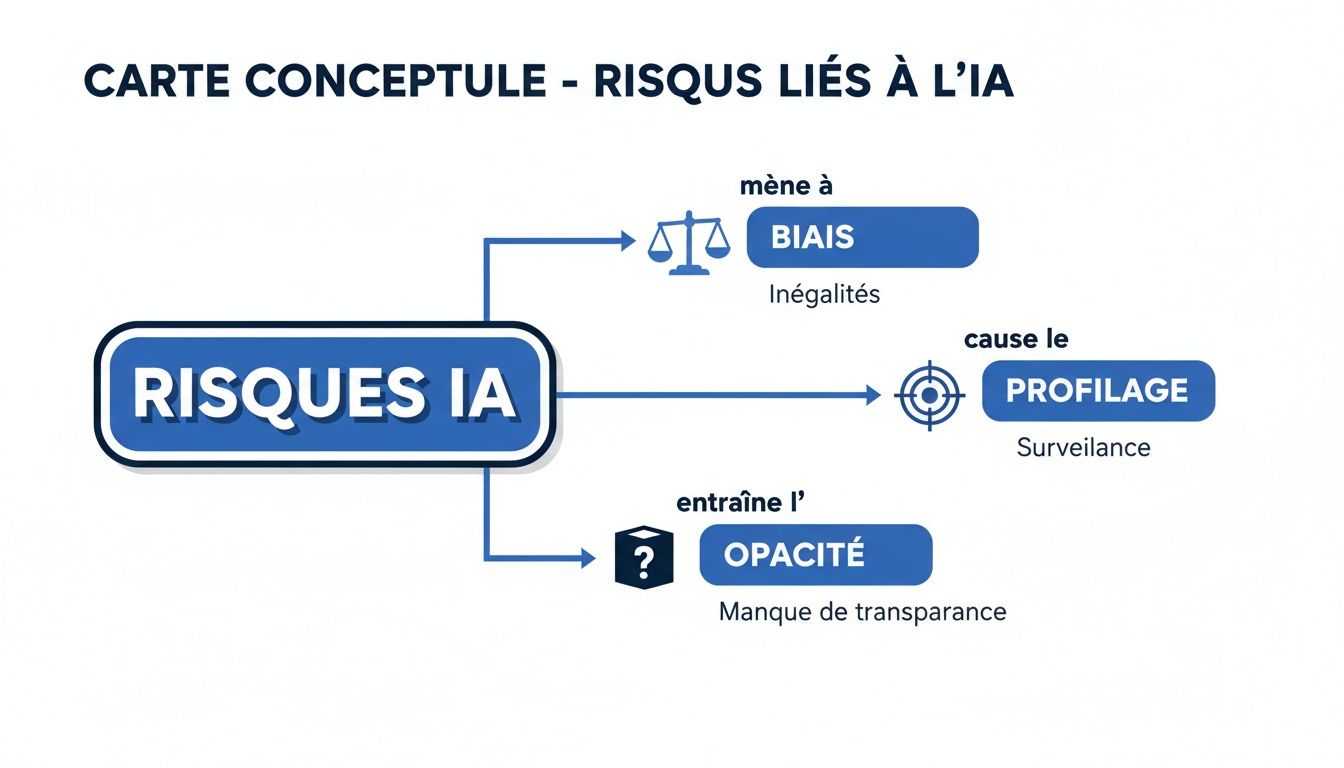

Cette carte mentale résume bien les risques principaux que sont les biais, le profilage et le manque de transparence.

On voit bien comment ces trois défis techniques s'entremêlent et constituent le noyau dur des préoccupations en matière de conformité.

Le diable est dans les détails (techniques et contractuels)

Une feuille de route qui marche ne se contente pas de grands principes. Elle doit s'enraciner dans le concret, surtout quand il s'agit de la documentation et de la relation avec vos fournisseurs de technologie.

La documentation des modèles est un point souvent zappé, et pourtant, c'est vital. Votre "boîte noire" doit avoir son propre manuel d'utilisation. Vous devez être capable de documenter avec précision :

Les données d'entraînement : D'où viennent-elles ? Sont-elles vraiment représentatives ? Comment avez-vous géré les biais potentiels ?

L'architecture du modèle : Quels algos sont utilisés ? Quels sont les paramètres importants ?

Les tests de performance : Comment avez-vous validé la précision et l'équité du modèle ?

Cette documentation, c'est votre meilleure assurance vie en cas de contrôle. C'est la preuve tangible que vous maîtrisez votre technologie et que vous ne naviguez pas à vue. Pour creuser le sujet et apprendre à évaluer la maturité de vos systèmes, jetez un œil à notre guide sur la manière de réaliser un audit de votre intelligence artificielle.

Et enfin, n'oubliez jamais que vous êtes rarement seul dans l'aventure. Si vous utilisez une solution d'IA fournie par un partenaire, le contrat est votre bouclier. Il doit dire, noir sur blanc, qui est responsable de quoi. Qui garantit la conformité des données d'entraînement ? Qui prend la responsabilité si l'algorithme prend une décision discriminatoire ? Ces questions doivent être réglées par écrit pour éviter les très mauvaises surprises. La conformité IA et RGPD, c'est un sport d'équipe, et les règles du jeu doivent être claires pour tous les joueurs.

Pourquoi les sanctions RGPD explosent en 2026

Vous pensez encore que les sanctions RGPD, c'est un truc réservé aux GAFAM ? Si c'est le cas, préparez-vous à un réveil qui pique. La période de grâce, où les autorités de contrôle se contentaient de taper gentiment sur les doigts, est bel et bien terminée. Fini la pédagogie, place à la répression. Et les chiffres parlent d'eux-mêmes.

L'année 2025 a été un véritable tournant. La CNIL a dégainé 87 sanctions pour non-conformité au RGPD, soit une augmentation fulgurante de 107 % par rapport à l'année d'avant. Rien que ça. Le montant total des amendes a grimpé à 55,2 millions d'euros pour les entreprises "classiques", mais a explosé à plus de 478 millions d'euros si on inclut les décisions contre les géants du web.

Cette escalade, combinée à une hausse de 15 % des contrôles, n'est pas un hasard. C'est le signal très clair que la fête est finie et que la mise en application du règlement est devenue beaucoup plus agressive. Pour creuser le sujet, je vous conseille de jeter un œil au bilan complet du RGPD en 2025 qui détaille ce qui nous attend pour 2026.

Ce changement de rythme modifie complètement l'équation du risque pour toutes les entreprises.

Les PME ne sont plus à l'abri

Pendant des années, on a tous entendu la même petite musique : « La CNIL n'a pas les moyens de contrôler tout le monde, je suis trop petit pour qu'ils s'intéressent à moi ». Cette excuse ne tient plus la route. Les autorités de protection des données se sont équipées d'outils plus performants et mènent désormais des contrôles ciblés, en particulier sur les secteurs qui se jettent sur les nouvelles technologies.

Et devinez quel est le signal d'alerte numéro un pour eux ? L'intelligence artificielle. Un projet d'IA mal ficelé, qui brasse des données personnelles sans une gouvernance solide, devient une cible prioritaire. La complexité de la relation IA et RGPD crée des failles béantes que les régulateurs adorent exploiter.

Penser que sa PME est hors du radar de la CNIL en 2026, c'est un peu comme traverser l'autoroute les yeux bandés en espérant que les camions vous éviteront. Le risque n'est plus théorique, il est statistique.

L'erreur la plus commune, ce n'est pas d'être mal intentionné. C'est juste d'être négligent.

La sécurité de base reste le talon d'Achille

Le plus ironique dans tout ça ? La première cause de sanction n'est pas toujours un montage juridique tordu autour d'une IA complexe. Le plus souvent, les amendes tombent pour des manquements aux bases de la sécurité des données, celles de l'article 32 du RGPD. Des trucs simples, mais aux conséquences dévastatrices.

On parle de négligences qui semblent presque caricaturales :

Des mots de passe faibles (voire absents) sur des bases de données critiques.

L'absence de chiffrement pour des données sensibles qui se baladent dans la nature.

Des mises à jour de sécurité qui n'ont pas été faites depuis des mois.

Des contrôles d'accès si laxistes que n'importe qui peut fouiller dans des infos confidentielles.

Ces failles de base sont des portes d'entrée grandes ouvertes, pas seulement pour les hackers, mais aussi pour les sanctions. Elles envoient un message très clair à la CNIL : « Chez nous, la gestion des données, c'est le cadet de nos soucis ».

Ce constat n'est pas là pour vous faire peur, mais pour vous aider à prendre une décision stratégique. Investir aujourd'hui dans une gouvernance IA et RGPD solide n'est pas une simple dépense. C'est l'une des meilleures assurances que vous puissiez souscrire pour votre business. Une protection active contre un risque financier et réputationnel qui peut faire dérailler le plus prometteur des projets d'innovation.

Et si on faisait de la conformité IA un vrai plus pour le business ?

Arrêtons de voir le RGPD comme une simple case à cocher ou, pire, un boulet. Et si on changeait complètement de disque ? Penser que le mariage entre l'IA et le RGPD n'est qu'une contrainte, c'est voir le petit bout de la lorgnette. La vraie bonne idée, c'est d'en faire un argument de vente qui claque.

Une boîte qui gère bien ce duo envoie un signal très clair au marché et à ses clients : "Chez nous, vous pouvez avoir confiance". Et croyez-moi, à une époque où tout le monde se méfie de tout, la confiance, c'est de l'or en barre.

Transformer une obligation légale en super-pouvoir commercial

Cette confiance, ce n'est pas juste un joli mot. Elle se transforme très vite en avantages concrets qui font la différence.

D'abord, elle fidélise vos clients. Ils se sentent écoutés, respectés, en sécurité. Ensuite, elle booste votre image de marque, qui devient synonyme d'innovation qui a du sens. Et pour finir, elle vous rend beaucoup plus sexy aux yeux des talents qui, de plus en plus, veulent bosser pour des entreprises qui partagent leurs valeurs.

Faire l'autruche sur les règles, même les plus simples, coûte de plus en plus cher. Regardez Free et Free Mobile, qui se sont pris une amende de 42 millions d'euros début 2026 pour des failles de sécurité basiques. Comme le montre bien cette analyse des sanctions RGPD en 2026, l'amateurisme n'est plus une option.

Bien gérer l'IA et le RGPD, ce n'est pas juste éviter les amendes. C'est se forger une réputation en béton qui attire les clients, rassure les investisseurs et motive vos propres équipes.

Par où commencer ? Vos 3 actions pour demain matin

OK, assez de blabla. Pour passer de l'idée à l'action, voici trois chantiers prioritaires à lancer sans attendre. C'est la base d'une innovation qui tient la route.

Faites le ménage dans vos IA actuelles : Jetez un œil sous le capot de ce qui tourne déjà. Votre mission ? Repérer les zones de flou, les traitements de données qui passent sous le radar et les risques potentiels.

Instaurez le réflexe "AIPD" pour tout nouveau projet : L'Analyse d'Impact doit devenir le ticket d'entrée obligatoire avant de se lancer tête baissée dans une nouvelle aventure avec de l'IA. Pas d'AIPD, pas de projet. C'est aussi simple que ça.

Formez vos équipes pour que ça devienne une seconde nature : La conformité, ce n'est pas que l'affaire des juristes. Du développeur au commercial, tout le monde doit avoir l'ADN "Privacy by Design".

En adoptant ces bonnes pratiques, vous ne faites pas que respecter la loi. Vous vous positionnez comme un pionnier, un leader de l'innovation qui ne laisse personne sur le bord de la route.

Si ce chantier vous paraît immense, faire appel à un consultant en IA peut vous faire gagner un temps précieux pour mettre tout ça en musique et transformer ce qui ressemble à une contrainte en un véritable atout stratégique.

Vos questions, nos réponses : le coin du juriste pour l'IA et le RGPD

Plonger dans l'IA tout en respectant le RGPD, c'est un peu comme naviguer en eaux vives. Ça soulève pas mal de questions. Démêlons ensemble les interrogations les plus fréquentes pour que vous puissiez garder le cap.

Puis-je utiliser les données de mes clients pour entraîner mon IA ?

Oui, mais attention, ce n'est pas open bar ! Utiliser des données personnelles pour muscler un algorithme, c'est un traitement de données à part entière. Et comme tout traitement, il lui faut une base légale en béton armé.

Dans la plupart des cas, vous devrez obtenir un consentement explicite et spécifique de la personne concernée. Concrètement, votre utilisateur doit savoir très clairement que ses données vont servir à ça, et il doit pouvoir dire "oui" ou "non" sans la moindre pression.

Votre boussole doit rester le principe de minimisation des données. N'utilisez que ce qui est absolument indispensable au bon fonctionnement de votre modèle. La question à se poser en permanence, c'est : "Est-ce que j'ai vraiment besoin de cette information pour que l'IA fasse son job ?". Pensez aussi à l'anonymisation ou à la pseudonymisation : dès que c'est possible, foncez ! C'est votre meilleure assurance vie pour limiter les risques. Et bien sûr, assurez-vous que les utilisateurs peuvent facilement exercer leurs droits, comme celui de s'opposer au traitement ou de demander la suppression de leurs données.

L'AIPD, c'est automatique pour un projet d'IA ?

Dans les faits, la réponse est un grand OUI dans 99% des cas. Une Analyse d'Impact sur la Protection des Données (AIPD) devient obligatoire dès qu'un traitement risque de mettre en péril les droits et libertés des gens.

Et soyons honnêtes, presque tous les projets d'IA cochent les bonnes cases :

On traite souvent des données à grande échelle.

On utilise des technologies nouvelles.

On fait du profilage ou de l'évaluation systématique.

On prend des décisions automatisées qui peuvent avoir un impact réel sur la vie des gens.

Ne voyez pas l'AIPD comme une corvée administrative. C'est votre check-up de sécurité, votre crash test avant le lancement. C'est le moment idéal pour cartographier les risques, montrer patte blanche et construire un système solide dès le premier jour.

Faire l'impasse sur une AIPD alors qu'elle était nécessaire, c'est une faute grave qui peut coûter très cher. Le bon réflexe ? La lancer pour tout projet d'IA d'une certaine envergure.

Et si l'IA se plante, c'est la faute à qui ?

La réponse est claire comme de l'eau de roche : c'est votre entreprise, en tant que responsable du traitement, qui est sur le gril. Impossible de se défausser en mode "c'est pas moi, c'est l'IA !".

C'est justement pour ça qu'une supervision humaine est non négociable. L'IA n'est qu'un outil, et vous en êtes le pilote. Pour maîtriser ce risque, voici les actions à mettre en place :

Gardez toujours un humain dans la boucle pour les décisions qui comptent vraiment.

Documentez tout, absolument tout : comment l'algorithme fonctionne, avec quoi il a été entraîné, les tests que vous avez faits...

Bétonnez vos contrats avec vos fournisseurs de solutions IA pour que les responsabilités de chacun soient limpides.

Cette documentation, c'est votre meilleure défense. Elle prouvera que vous avez pris toutes les précautions pour garder la maîtrise de votre technologie et éviter les dérapages.

Mettre sur pied une stratégie IA qui soit à la fois performante et conforme, ce n'est pas une promenade de santé. Chez AI MAKERS, on vous aide à transformer ce défi en véritable avantage sur vos concurrents. Découvrez comment notre méthode AI-First peut sécuriser et accélérer vos projets d'innovation.