16 févr. 2026

Guide intelligence artificielle consommation énergie pour sobriété et rendement

Découvrez intelligence artificielle consommation énergie et comment l'optimiser pour réduire coûts et ROI grâce à des conseils concrets.

Imaginez l'IA comme un athlète de haut niveau. Pour claquer des performances, il lui faut une énergie monstre. On la croit souvent éthérée, planant dans le "cloud", mais la réalité est bien plus terre-à-terre : l'intelligence artificielle est en passe de devenir l'un des plus gros goinfres électriques de notre époque.

Une simple discussion avec un chatbot ? C'est potentiellement dix fois plus d'énergie qu'une bête recherche sur Google. Rien que ça.

L'IA, ce nouveau glouton qui se cache dans vos serveurs

Cette boulimie énergétique de l'IA n'est pas qu'un casse-tête pour ingénieurs. C'est un vrai sujet stratégique pour toute entreprise qui se lance. On ne peut plus innover en IA sans regarder la facture d'électricité qui gonfle, et avec elle, l'impact sur la planète. Pour un décideur, piger ce qui se joue là est tout simplement crucial pour piloter une transformation qui tienne la route, sur le plan financier comme sur le plan éthique.

Et attention, le phénomène prend de l'ampleur à une vitesse folle. D'ici 2030, on estime que l'IA pourrait pomper entre 35 et 50 % de l'électricité des datacenters en France, contre à peine 5 à 15 % aujourd'hui. Pour un directeur marketing ou un membre du COMEX, cette courbe annonce des coûts cachés qui risquent de faire mal. Surtout quand on sait que le gros de la dépense (70 à 80 %) vient de l'utilisation de tous les jours, bien plus que de la création des modèles. Pour creuser le sujet, n'hésitez pas à jeter un œil à ces statistiques sur l'intelligence artificielle.

Transformer la contrainte en avantage compétitif

Alors, on baisse les bras ? Sûrement pas. Les boîtes les plus malignes voient déjà cette contrainte comme une occasion en or. En optimisant l'empreinte énergétique de leurs projets IA, elles gagnent sur tous les tableaux.

Réduire les coûts, tout simplement. Moins de kWh consommés, c'est une facture d'hébergement qui s'allège.

Booster l'image de marque. Une IA "verte", ça parle aux clients et aux talents.

Prendre un temps d'avance sur les réglementations environnementales qui ne manqueront pas de tomber.

Innover pour de bon, en créant des IA plus futées, plus légères et plus efficaces.

Ce guide a été pensé pour ça : vous donner les clés. On va décortiquer le sujet, du B.A.-BA (la différence entre entraînement et inférence, par exemple) jusqu'aux actions concrètes que vous pouvez lancer dès demain. Le but est limpide : faire rimer performance technologique avec responsabilité, pour vous construire un avantage concurrentiel qui dure.

Entraînement vs inférence : le sprint et le marathon énergétique de l'IA

Pour vraiment piger l'empreinte énergétique de l'intelligence artificielle, il faut voir les choses en deux temps. C'est un peu comme construire une usine, puis la faire tourner au quotidien. Ce sont deux moments bien distincts, avec des besoins et des factures radicalement différents.

D'un côté, il y a l'entraînement (le fameux training). Pensez-y comme à un sprint énergétique monumental, un investissement colossal et ponctuel. C'est la phase d'apprentissage, où le modèle d'IA avale des quantités astronomiques de données – textes, images, lignes de code, tout y passe. Une véritable phase de construction, où des milliers de processeurs graphiques (GPU) turbinent à plein régime pendant des semaines, voire des mois.

Cette opération est si gourmande qu'entraîner un grand modèle de langage peut engloutir plusieurs gigawattheures (GWh). Pour vous donner une idée, c'est l'équivalent de la consommation annuelle de centaines de foyers. Un coût initial vertigineux, mais qui, en théorie, ne se produit qu'une seule fois pour une version donnée du modèle.

L'inférence, ce marathon énergétique discret mais constant

De l'autre côté, il y a l'inférence. Si l'entraînement était un sprint, l'inférence est un marathon qui ne s'arrête jamais. C'est tout simplement l'utilisation de l'IA au quotidien, une fois qu'elle est "construite" et en service. Chaque question posée à un chatbot, chaque image analysée par une appli, chaque suggestion de code... tout ça, c'est de l'inférence.

Prise isolément, chaque requête semble être une goutte d'eau, une consommation quasi-négligeable. Le piège, c'est l'effet d'échelle. Multipliez ces gouttes par des millions, voire des milliards d'utilisations chaque jour, et vous obtenez un véritable fleuve énergétique. Cette phase est constante et s'étale sur toute la durée de vie du modèle.

On pourrait croire que le sprint de l'entraînement coûte le plus cher. Détrompez-vous. C'est bien l'inférence qui domine la consommation globale, représentant entre 70 % et 80 % de la facture énergétique totale d'un modèle d'IA sur son cycle de vie.

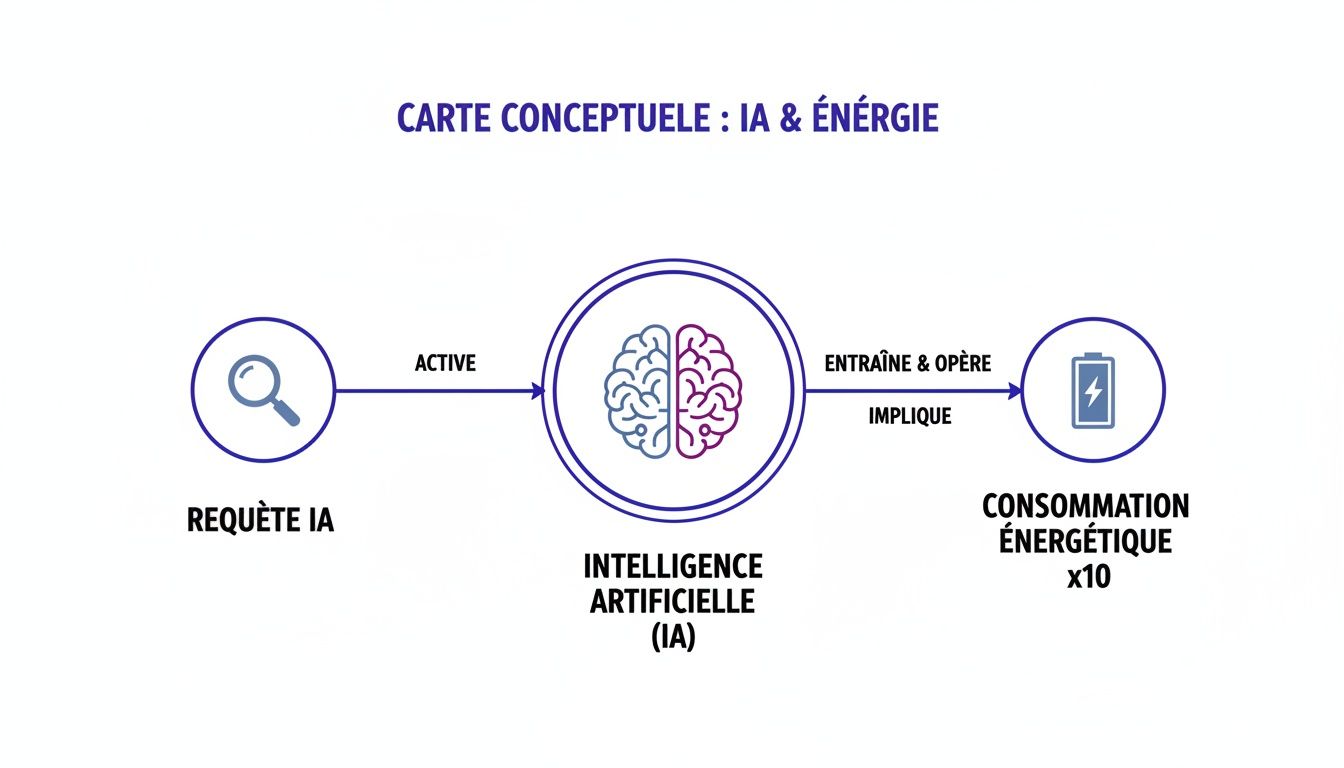

Ce visuel illustre parfaitement l'idée : chaque requête faite à une IA déclenche une cascade de calculs, démultipliant la consommation d'énergie par rapport à une recherche web classique.

On voit bien que c'est l'usage répété et quotidien qui fait exploser les compteurs, bien plus que la création initiale du modèle.

Entraînement vs Inférence : qui consomme quoi

Pour y voir plus clair, voici un petit tableau comparatif qui résume les différences clés entre ces deux phases. C'est essentiel pour savoir où concentrer vos efforts d'optimisation.

Caractéristique | Entraînement (La construction) | Inférence (L'utilisation quotidienne) |

|---|---|---|

Nature du processus | Un sprint unique et massif. | Un marathon constant et répété. |

Fréquence | Ponctuelle (une fois par version de modèle). | Continue (à chaque requête utilisateur). |

Intensité | Extrêmement élevée sur une courte période. | Faible par requête, mais massive en cumulé. |

Type de coût | CAPEX (dépense d'investissement). | OPEX (dépense de fonctionnement). |

Part de la conso. totale | 20 % à 30 %. | 70 % à 80 %. |

Principal levier d'action | Optimiser l'infrastructure (GPU, PUE). | Optimiser le modèle (taille, efficacité). |

Ce tableau met en lumière un point crucial : si l'entraînement est spectaculaire, c'est bien l'inférence qui constitue le nerf de la guerre pour la maîtrise des coûts et de l'impact environnemental.

Pourquoi cette distinction change tout pour un décideur

Pour vous, dirigeant, saisir cette nuance n'est pas un détail technique. C'est stratégique. Se focaliser uniquement sur le coût de l'entraînement, c'est un peu comme admirer la partie émergée de l'iceberg en oubliant les 90 % sous l'eau. Le véritable enjeu financier et écologique se joue dans l'optimisation de l'inférence.

Voilà ce que ça implique concrètement pour votre stratégie :

Où concentrer les efforts ? L'optimisation doit viser à réduire l'énergie consommée par chaque requête. Souvent, un modèle plus petit et spécialisé sera bien plus malin et économe qu'un mastodonte "à tout faire".

Comment maîtriser les coûts ? La facture de l'inférence est une charge d'exploitation récurrente. Plus votre service IA a du succès, plus elle grimpe. La garder sous contrôle est la clé de la rentabilité sur le long terme.

Quel est votre véritable impact ? L'empreinte carbone de votre IA se construit jour après jour, requête après requête. Agir sur l'inférence est de loin le levier le plus puissant pour tendre vers une IA plus sobre.

En un mot : l'entraînement, c'est le ticket d'entrée, une dépense en capital impressionnante mais ponctuelle. L'inférence, c'est le coût de la vie au quotidien, un marathon qui définira si votre stratégie IA est un succès durable... ou un gouffre financier.

Comment mesurer l'empreinte carbone de vos projets IA ?

Piloter la consommation de l'IA sans la mesurer, c'est un peu comme naviguer en plein brouillard sans boussole. Pour transformer cette contrainte énergétique en un véritable avantage compétitif, la première étape est de mettre des chiffres clairs sur la table.

Heureusement, évaluer l'empreinte de vos projets d'IA est bien plus accessible qu'il n'y paraît. Ça va bien au-delà de la simple lecture d'un compteur électrique. L'idée est d'adopter des indicateurs qui parlent aussi bien à vos équipes techniques qu'à votre comité de direction.

Au-delà du kilowattheure : les métriques qui comptent vraiment

Le kilowattheure (kWh), c'est la base. L'unité brute de l'énergie dévorée par vos serveurs. Mais tout seul, il ne raconte pas toute l'histoire de votre impact réel. Pour avoir une vision à 360°, deux autres indicateurs sont incontournables.

L'équivalent CO2 (CO2e) : Voilà la métrique qui traduit votre consommation électrique en impact climatique. Elle prend en compte le fameux "mix énergétique" de l'électricité que vous utilisez. Un kWh en France, avec son parc nucléaire, n'a pas du tout le même poids carbone qu'un kWh dans une région qui carbure au charbon. C'est un critère essentiel pour choisir un fournisseur cloud qui colle à vos ambitions de durabilité.

Le Power Usage Effectiveness (PUE) : Cet indicateur est le thermomètre de l'efficacité de votre data center. Il compare l'énergie totale consommée par le centre (refroidissement, éclairage, etc.) à celle réellement utilisée par les serveurs. Le PUE parfait, c'est 1.0.

Un PUE de 1.2 est déjà considéré comme excellent : ça veut dire que "seulement" 20 % de l'énergie part en fumée dans les systèmes annexes. À l'inverse, un PUE de 1.8 doit allumer les warnings : pour chaque watt utilisé pour le calcul, vous dépensez presque un autre watt juste pour refroidir le bâtiment.

Maîtriser ce trio (kWh, CO2e, et PUE) est la première étape pour passer d'une vision floue à un pilotage chirurgical de la consommation énergie de votre intelligence artificielle. C'est le moyen le plus rapide d'identifier les sources de gaspillage et les optimisations les plus rentables.

Pour creuser les principes généraux, ce guide pour calculer son empreinte carbone offre des bases solides et très complémentaires.

Mettre les chiffres en perspective

La situation en France est un cas d'école qui illustre l'urgence d'agir. Selon les prévisions de l'ADEME et de l'Arcep, l'impact carbone de l'IA pourrait exploser pour atteindre 50 millions de tonnes de CO2 en 2050, soit le triple du niveau actuel ! Cette flambée est directement liée à la multiplication des data centers, dont les émissions ont déjà bondi de 10 % en 2023. Dopés par les besoins de l'IA, ces centres ont englouti entre 4 et 6 TWh cette année-là, une énergie concentrée à 78 % sur seulement 21 % des plus gros sites.

Ces chiffres le montrent : l'inaction n'est pas une option. Mesurer précisément votre empreinte est le point de départ pour ne pas subir cette inflation des coûts énergétiques. Un audit de votre intelligence artificielle est souvent le meilleur moyen d'établir ce diagnostic initial et de tracer une feuille de route claire.

Des outils pour passer à l'action

Plusieurs outils, souvent proposés par les fournisseurs cloud eux-mêmes (comme AWS, Google Cloud ou Azure), permettent de suivre ces indicateurs à la trace. Ils fournissent des tableaux de bord qui permettent de visualiser la consommation par projet, par région ou par service.

Des solutions open source comme CodeCarbon ou Experiment Impact Tracker peuvent aussi être intégrées directement par vos équipes MLOps. Elles calculent automatiquement l'empreinte carbone de l'entraînement de vos modèles en se basant sur le matériel utilisé, la durée du calcul et la localisation géographique des serveurs.

En équipant vos équipes de ces outils, vous faites bien plus que surveiller des coûts. Vous installez une culture de la mesure et de la responsabilité, où chaque décision technique est aussi évaluée à l'aune de son impact énergétique et, au final, de sa rentabilité.

4 leviers concrets pour une IA plus verte et plus rentable

Réduire la consommation d'énergie de votre intelligence artificielle n'est pas une quête idéaliste, c'est un impératif stratégique qui tape directement dans votre portefeuille. La bonne nouvelle ? Vous avez des cartes en main pour reprendre le contrôle.

Oublions les concepts fumeux et passons à l'action. Voici quatre axes concrets, de la conception du modèle jusqu'à son déploiement. Chaque étape est une occasion en or de couper dans les coûts, de booster l'efficacité et de se forger un avantage concurrentiel qui tient la route.

1. Optimiser les modèles : l'art de la légèreté

Le premier réflexe est souvent de sauter sur le modèle le plus gros et le plus impressionnant du marché. Erreur. Un modèle gigantesque, c'est comme utiliser un semi-remorque pour livrer une pizza : c'est cher, lent et d'une inefficacité redoutable.

Le secret, c'est de choisir ou d'affiner une IA parfaitement taillée pour sa mission. C’est ce qu'on appelle la « sobriété algorithmique ».

Visez des architectures légères : Au lieu d'un mastodonte généraliste comme GPT-4, un modèle plus petit et spécialisé (une version affinée de Llama 3 ou Mistral, par exemple) fera souvent mieux le job pour une tâche précise, tout en étant jusqu'à 100 fois moins énergivore.

Maîtrisez la distillation et la quantification : Imaginez que vous puissiez « compresser » un grand modèle dans une version de poche, qui garde l'essentiel de sa puissance mais consomme une fraction des ressources. C'est exactement ce que font ces techniques.

Penser « léger » dès le départ, c'est le premier pas vers une IA rentable. Les gains en performance et les économies vous surprendront. Pour aller plus loin et intégrer des pratiques Green IT à l'échelle de l'entreprise, il faut penser durabilité à tous les étages.

2. Choisir une infrastructure plus intelligente

Votre IA ne flotte pas dans un éther magique ; elle tourne sur des serveurs bien réels, dans un data center. L'efficacité de ce centre a un impact direct sur votre facture et votre empreinte carbone.

Le choix de votre hébergeur n'est donc pas un simple détail technique, c'est une décision stratégique. Deux points à surveiller comme le lait sur le feu :

Le PUE (Power Usage Effectiveness) : On en a déjà parlé, et c'est crucial. Visez des data centers avec un PUE qui frôle le 1.1. C'est le signe d'une installation moderne où l'électricité sert à calculer, pas à ventiler dans le vide. Le mix énergétique : Donnez la priorité aux fournisseurs qui carbure aux énergies renouvelables ou bas-carbone. Un data center alimenté par de l'hydroélectricité ou du nucléaire aura un impact CO2 bien plus sympathique qu'un autre qui tourne au charbon.

Les grands du cloud comme Google Cloud ou Microsoft Azure proposent même des outils pour choisir les régions les moins carbonées. Servez-vous-en !

3. Industrialiser avec une approche MLOps rigoureuse

Le MLOps, c'est le DevOps, mais pour le machine learning. Concrètement, c'est un ensemble de pratiques pour mettre de l'ordre dans le cycle de vie de vos modèles, de la R&D à la mise en production. Et c'est un levier d'économies d'énergie phénoménal.

Sans MLOps, c'est vite le Far West : des entraînements de modèles qui tournent en boucle pour rien, des ressources allouées 24/7 « au cas où », un vrai gaspillage organisé.

Automatisez les entraînements (intelligemment) : On ne ré-entraîne un modèle que si ses performances se dégradent de manière mesurable. Pas juste parce que c'est mardi.

Monitorez la consommation : Installez des outils pour traquer ce que vos modèles consomment en production. Vous repérerez vite les plus gourmands et saurez où frapper en premier.

Pensez "scale-to-zero" : C'est la star du moment. Configurez votre infra pour qu'elle ne s'allume que lorsqu'une requête arrive. Le reste du temps, elle dort et ne consomme rien.

Une gestion MLOps bien ficelée, c'est la fin du gaspillage. Chaque kWh dépensé sert vraiment à quelque chose. En appliquant ces méthodes, vous verrez comment l'optimisation des processus grâce à l'IA va bien au-delà de la simple gestion de l'énergie.

4. L'éternel débat : Edge ou Cloud ?

Dernière question, et pas des moindres : où faire tourner les calculs ? Traditionnellement, tout se passe dans le cloud. Mais une alternative prend de l'ampleur : le Edge computing.

L'idée est toute simple : effectuer une partie des calculs de l'IA directement sur l'appareil de l'utilisateur (un smartphone, un capteur industriel, etc.).

Le Edge computing est une solution de choix pour :

La faible latence : Quand la réponse doit être instantanée, traiter la donnée sur place évite les allers-retours avec le cloud.

La confidentialité : Les données sensibles ne quittent jamais l'appareil, ce qui renforce la sécurité.

La réduction de la charge serveur : Moins de requêtes envoyées au cloud, c'est moins de serveurs qui tournent, et donc une facture d'électricité allégée pour tout le monde.

Le Edge n'est pas la solution miracle à tous les problèmes, mais c'est une corde de plus à votre arc. Le meilleur compromis est souvent un modèle hybride : les tâches simples sont gérées en local, et les calculs lourds restent bien au chaud dans le cloud.

Pilotez votre stratégie IA par le portefeuille et le bon sens

Ne nous voilons pas la face. Parler de la consommation d'énergie de l'intelligence artificielle sous un angle purement technique ou écolo, c'est passer à côté de l'essentiel pour un dirigeant. La vraie question, c'est celle du business. De la gouvernance. Et surtout, de la rentabilité. Une IA qui engloutit de l'énergie n'est pas juste un problème pour la planète ; c'est avant tout un trou dans votre bilan financier.

L'efficacité énergétique doit donc s'inviter à la table des grands. Elle doit devenir un pilier de votre stratégie IA, au même titre que la performance brute ou la dernière innovation à la mode. La question n'est plus de savoir si il faut optimiser, mais comment transformer cette chasse au gaspillage en un avantage concurrentiel qui claque. C'est en intégrant cette dimension dès le premier jour que vous bâtirez une feuille de route solide et, surtout, profitable.

Calculez le vrai coût de votre IA, pas juste la facture du cloud

Pour piloter intelligemment, il faut mesurer honnêtement. Le coût d'un projet IA, ce n'est pas seulement le chèque pour les licences ou les salaires des data scientists. Il est temps d'adopter une vision 360°, celle du Coût Total de Possession (TCO), en y injectant une bonne dose de réalité énergétique.

Ce TCO version 2.0 cache plusieurs couches de coûts, souvent bien planquées :

Les coûts directs de l'énergie : Le plus évident, bien sûr. C'est la facture d'électricité qui gonfle à chaque entraînement et, pire encore, à chaque fois que votre modèle tourne en production. Garder un œil de lynx sur cet OPEX est le b.a.-ba.

Les coûts de l'infrastructure : Choisir un data center avec un bon PUE et une électricité verte a un coût d'entrée, c'est vrai. Mais c'est un investissement qui rapporte gros en économies et en tranquillité d'esprit sur le long terme.

Les coûts de la paperasse (conformité) : Les réglementations environnementales se durcissent. Anticiper les taxes carbone ou les rapports obligatoires (pensez à la directive CSRD en Europe) vous évitera des amendes salées et des réajustements faits dans la panique.

Les coûts de réputation (ou son bonus !) : Une IA "verte", ça fait bien. Ça rassure les clients, ça attire les talents et ça plaît aux partenaires. À l'inverse, l'inaction peut vite vous coller une étiquette de dinosaure, et ça, ça coûte très cher en image.

En additionnant tout ça, vous aurez enfin une vision claire du vrai prix de votre IA, bien au-delà de la ligne "frais cloud" qui sourit sur votre budget.

L'efficacité énergétique : votre meilleur levier de ROI

Une fois que votre TCO est au clair, l'étape suivante est logique : l'intégrer dans le calcul du Retour sur Investissement (ROI) de chaque projet. Et là, magie ! L'efficacité énergétique cesse d'être une contrainte pour devenir un accélérateur de rentabilité.

En intégrant la facture énergétique dans le calcul du ROI, la sobriété numérique passe du statut de "centre de coût" à celui de "centre de profit". Chaque euro économisé sur l'électricité est un euro qui tombe directement dans la poche de la rentabilité du projet.

Concrètement, qu'est-ce que ça veut dire ? Simplement qu'il faut évaluer chaque initiative IA sur deux axes : ce qu'elle peut rapporter (en productivité, en ventes...) et ce qu'elle va coûter en énergie. Un projet peut sembler génial sur le PowerPoint, mais si son coût à l'usage explose une fois en production, son ROI risque de virer au rouge écarlate.

Bâtir une feuille de route IA qui a les pieds sur terre

Pour que cette belle vision ne reste pas lettre morte, votre feuille de route stratégique doit intégrer la sobriété comme un critère non négociable.

Voici comment faire, en trois temps :

Faites le ménage dans l'existant : Commencez par faire l'inventaire de vos IA actuelles. Traquez les plus gourmandes et recalculez leur ROI avec les coûts énergétiques. Les premières victoires faciles se cachent souvent ici.

Fixez des règles du jeu claires : Donnez des objectifs chiffrés (KPIs) à vos équipes, liés à l'énergie. Par exemple, un "coût par prédiction" à ne pas dépasser, ou un objectif de réduire l'empreinte CO2e de 15 % d'ici un an.

Soyez sélectif pour l'avenir : Pour chaque nouvelle idée de projet, exigez une analyse d'impact énergétique. Donnez la priorité aux projets qui misent sur des modèles plus légers, qui exploitent l'IA en local (Edge computing) ou qui reposent sur des infrastructures déjà optimisées.

En adoptant cette gouvernance, vous ne faites pas qu'un geste pour la planète. Vous installez une discipline financière et opérationnelle qui rend votre stratégie IA plus solide, plus rentable et, au bout du compte, bien plus intelligente. Vous transformez une contrainte technique en un puissant moteur de performance économique.

Faites de la sobriété numérique une culture, pas une contrainte

Soyons clairs : vous pouvez avoir le système d’IA le plus affûté et l'infra la plus écolo du monde, si vos équipes ne sont pas dans le coup, tout ça ne sert à rien. Le dernier kilomètre, le plus décisif pour maîtriser la consommation d'énergie de votre intelligence artificielle, c’est l’humain. La sobriété numérique, ça ne se décrète pas depuis une tour d’ivoire, ça se cultive sur le terrain.

Le véritable défi ? Transformer vos collaborateurs en ambassadeurs d’une IA responsable. Il faut faire de l’efficacité énergétique un réflexe business, un critère de performance aussi important que la vitesse ou la précision d’un modèle.

Du réflexe du "toujours plus" à la culture du "juste assez"

Le vrai changement, c’est celui des mentalités. Il est temps de passer de l'obsession du "plus gros, plus puissant" à une approche plus fine du "juste ce qu'il faut". Concrètement, ça veut dire donner à vos équipes les clés pour qu'elles se posent les bonnes questions avant même de démarrer un projet.

Quelles questions ? Celles qui doivent devenir une seconde nature :

A-t-on vraiment besoin de tout ré-entraîner depuis le début ? Bien souvent, un simple fine-tuning sur un modèle existant fait des miracles, pour une fraction du coût énergétique.

Peut-on utiliser une version plus légère ? Pour une tâche précise, un petit modèle spécialisé sera souvent plus performant et jusqu'à 100 fois moins gourmand qu'un mastodonte généraliste.

L’inférence doit-elle tourner 24/7 ? Pour des besoins ponctuels, une architecture qui s'éteint entre deux requêtes ("scale-to-zero") est une mine d'or en termes d'économies.

Ces quelques questions, posées au quotidien, sont la pierre angulaire d’une véritable culture de la sobriété.

Formez des champions pour diffuser la bonne parole

Pour que cette culture prenne vraiment, elle a besoin de relais. La stratégie gagnante ? Identifier et former des "AI Champions" au cœur de vos équipes. Ces référents deviennent les missionnaires de l'IA sobre, capables de guider leurs collègues et de faire remonter les bonnes pratiques du terrain.

L'idée n'est pas de faire de chaque collaborateur un expert en MLOps. L'objectif, c'est de leur faire prendre conscience de l'impact énergétique de leurs gestes. C'est l'accumulation de milliers de petites décisions optimisées qui fera une différence colossale sur la facture finale.

La formation est évidemment le nerf de la guerre. Des programmes ciblés aident vos équipes à comprendre ce qui se cache derrière la consommation des data centers. En 2023, les centres de données en France métropolitaine ont avalé entre 4 et 6 TWh d'électricité ! Le plus frappant, c'est que 21 % des centres de données consomment 78 % de l'électricité totale. Une consommation qui a bondi de 21 % en cinq ans à peine, tirée par les plus gros acteurs. Si vous voulez creuser, jetez un œil aux données de l'INSEE sur la consommation électrique des data centers.

Intégrez la sobriété dans vos objectifs et vos rituels

Pour que la mayonnaise prenne durablement, il faut que cette culture soit visible et intégrée aux rouages de l'entreprise.

Ajoutez des KPIs énergétiques : Intégrez des indicateurs comme le "coût par requête" ou l'empreinte CO2e dans les tableaux de bord de vos projets IA. Ce qui est mesuré est amélioré.

Célébrez les victoires : Mettez en avant les équipes qui trouvent des astuces pour réduire la consommation. Faites-en des exemples à suivre pour toute l'entreprise.

Faites-en un sujet récurrent : Que ce soit en comité de direction ou en point d'équipe, parlez de sobriété aussi naturellement que vous parlez budget ou délais.

En formant des AI Champions pour devenir le référent IA dans votre organisation, vous faites bien plus que réduire vos factures. Vous alignez votre innovation technologique sur une vision durable et transformez ce qui semble être une contrainte en un véritable moteur de performance et d’engagement.

Les questions que tout le monde se pose sur l'IA et l'énergie

Passons aux choses sérieuses. Vous vous posez sans doute un tas de questions sur l'impact de l'intelligence artificielle. Voici quelques réponses directes, sans langue de bois, pour vous aider à y voir plus clair.

L'IA, c'est vraiment si grave pour la planète ?

Oui, ne nous voilons pas la face. L'impact est bien réel et il grandit à une vitesse folle.

Le mythe d'une IA "immatérielle" a la vie dure, mais la réalité est tout autre. Derrière chaque requête se cachent des centres de données qui tournent à plein régime, dévorant des quantités astronomiques d'électricité. Et cette électricité vient encore trop souvent d'énergies fossiles. Sans oublier la fabrication des puces (les fameux GPU), un processus qui engloutit des ressources précieuses et des litres d'eau. Le problème est donc double : la facture énergétique et l'empreinte matérielle de l'infrastructure.

Concrètement, est-ce que je peux faire quelque chose à mon échelle ?

Bien sûr ! Et votre rôle est même crucial. Vous avez plusieurs cartes en main :

Jouer la carte de la simplicité : Pourquoi sortir l'artillerie lourde pour une tâche simple ? Choisissez des modèles plus légers, adaptés au besoin.

Choisir les bons partenaires : Privilégiez les hébergeurs cloud qui jouent la transparence, qui communiquent sur leur PUE (Power Usage Effectiveness) et qui s'engagent sur un mix énergétique vert.

Maîtriser l'usage : Mettez en place une vraie gouvernance MLOps. L'idée ? Stopper les entraînements qui tournent dans le vide et s'assurer que les ressources ne sont sollicitées qu'en cas de besoin réel.

Mais une IA "verte", c'est moins performant, non ?

C'est une idée reçue, et c'est même tout le contraire. Une IA sobre est avant tout une IA plus intelligente dans sa conception.

En forçant vos équipes à penser "efficacité", vous les poussez à créer des algorithmes plus affûtés, plus rapides, et qui vont droit au but. C'est un excellent stimulant pour l'innovation. Au final, on se retrouve avec des systèmes plus performants et, cerise sur le gâteau, plus rentables.

Penser "efficacité énergétique" dès le départ d'un projet IA, ce n'est pas se rajouter une contrainte. C'est une discipline qui oblige à mieux penser l'allocation des ressources. Le résultat ? Un bien meilleur retour sur investissement.

Et si je ne fais rien, quel est le risque ?

Ignorer la consommation énergétique de l'intelligence artificielle, c'est un peu comme naviguer à vue en pleine tempête. Les risques sont bien là, et ils ne feront que grandir.

D'abord, vos coûts opérationnels vont grimper en flèche avec le prix de l'électricité. Ensuite, attendez-vous à voir débarquer de nouvelles réglementations environnementales qui pourraient vous prendre de court. Et enfin, il y a le risque d'image : vos clients, vos partenaires et les talents que vous voulez attirer sont de plus en plus regardants sur l'engagement écologique des entreprises. Ne rien faire aujourd'hui, c'est s'assurer des problèmes pour demain.

Transformer ces défis en opportunités, ça vous tente ? Pour bâtir une feuille de route IA qui allie performance et responsabilité, la première étape est de savoir d'où vous partez. Chez AI MAKERS, nous vous aidons à auditer vos systèmes pour identifier les gains rapides et assurer un ROI immédiat. Découvrez notre approche pragmatique.